AIインフラと聞くと、多くの人は大規模言語モデル(LLM)のトレーニングに注目しがちです。しかし、トレーニングはあくまで序章にすぎません。AI推論の進化に伴い、ネットワークにおける真の試練と負荷は、迅速かつ大規模に対応することにあります。LLMはAIファクトリーから、何十億人もの人々が日常的に利用する製品へと移行しつつあります。これについて、Cienaのフランシスコ・サンタンナが解説します。

電力消費の大きいデータセンターに設置された大規模GPUクラスターがペタビット級で接続されてトレーニングに用いられる様子は、AIがネットワークに与える影響を具体的かつ劇的に示しています。一方で、推論のワークロードはジョブ単位でははるかに軽量です。しかし、その増加は急速で、世界規模に広がっており、影響範囲も拡大しています。AIがマルチモーダル化し、コンテキスト認識が進み、デジタル・プラットフォーム全体に深く組み込まれていく中で、推論は将来のネットワーク需要を牽引する主要な要因として台頭しています。

前例のないペースで進むAI導入

社会を変革してきた電話、コンピューター、インターネット、スマートフォンといった技術は、数億人のユーザーに到達するまでに数十年を要しました。デジタル配信の時代になっても、そのような技術の普及には数年かかりました。Netflixは1億人のユーザーに到達するまでに10年を要し、Facebookは4年、Instagramは2年強、TikTokは9か月かかってこのマイルストーンに達しました。しかし、AIはこのような技術の普及のタイムラインをさらに短縮しています。

ChatGPTは、わずか2か月で月間アクティブユーザー(MAU)1億人に到達しました。GoogleのGeminiアプリは、18か月もかからずに4億5,000万人のMAUを突破しました。新たなAIアプリの登場に加え、より重要なのは、既存のデジタル・プラットフォームにAIが組み込まれたときに何が起こるかです。検索、メール、生産性ソフトウェア、地図、広告、SNSのリーチは、すでに数十億人ものユーザーに達しています。そこにAIを追加すると、その普及は段階を踏むのではなく、瞬時にスケールが拡大します。

GoogleによるAI Overviewsのロールアウトは、その好例です。Geminiを活用した機能を検索に導入してから1年もたたないうちに、この機能は毎月20億人以上に利用されるようになりました。現在、AIによる機能強化は、Google、Microsoft、Metaをはじめとする主要なデジタル・プラットフォームの製品ポートフォリオ全体に広がっています。その結果、推論の処理量は爆発的に増加しています。Googleは、2025年初頭において、同社が毎月処理するAIトークン(テキストの基本単位)の数が前年比で50倍に増加し、そのわずか2か月後にはさらに倍増したと報告しています。

ただし、AI推論の処理量がそのままインフラ需要の増加に直結するわけではありません。AIプロバイダーは、既存のリソースでより多くを処理できるよう、推論の効率を向上させています。例えばMicrosoftは、GPU1基あたりで処理できるトークン数が前年比で約90%増加したと報告しています。しかし、アルゴリズムやアーキテクチャーの効率化で吸収できるのは、推論ワークロード増加の一部に過ぎません。AIの利用がコンシューマー向けおよびエンタープライズ向けアプリケーション全体に拡大する中で、大量のGPUと急速に拡張する推論向けデータセンターが世界中で展開されています。このような計算リソースの増加と地理的分散だけでも、推論ワークロード自体の進化を考慮するまでもなく、拠点間において、回復力の高い大容量接続の重要性が一層高まっています。

テキストベースAIの影響はごくわずか、マルチモーダルAIが状況を一変

これまでのところ、AIがインターネット全体のトラフィックに与える影響は比較的限定的でした。テキストベースのやり取りで生成されるデータ量は非常に少なく、1回のやり取りあたり数キロバイト程度にすぎません。大規模に展開された場合でも、そのトラフィックはビデオのストリーミングと比べるとごくわずかです。しかし、マルチモーダルAIによってこの前提が覆されたのです。

マルチモーダル・システムでは、テキスト、画像、音声、ビデオ、さらには3Dコンテンツの処理と生成が行われます。ユーザーはテキストを入力して文章で回答を受け取るだけでなく、写真のアップロードや、ビデオのストリーミング、リッチなビジュアル出力の要求もできます。スマートフォンによる高精細なビデオストリーム(720p・30fps)1本でも、上り帯域として2~3Mb/sの継続的な帯域幅を必要とし、1分あたり約15~22MBのデータ量になります。これが数億から数十億のユーザー規模になると、推論トラフィックの様相は大きく変わってきます。

この変化はすでに始まっています。Google、OpenAI、Anthropic、xAI、Alibabaなどは、マルチモーダル・モデルを提供しています。Googleのレンズ機能の利用は、わずか数か月でクエリ数が数十億件増加しました。GoogleのProject AstraやOpenAIのGPT-4oといったプロダクトデモでは、ライブ動画フィードをリアルタイムで処理し、文脈に応じて応答するAIアシスタントが示されています。これらの機能が広く普及すれば、アクセス、メトロ、コアネットワーク(海底および地上)のトラフィック増加に関する従来の前提が見直されることになります。

推論モデルとディープサーチがデータ移動をさらに増大

推論ワークロードは単に大きくなっているだけでなく、より高度化し、複雑さも大きく増しています。推論モデルは、回答を生成する前に、複雑なタスクを複数の内部ステップに分解します。このような見えない推論プロセスにより、従来の「即時」型モデルと比べて、1クエリあたり3~10倍の計算リソースが必要になることもあります。

また、これらのモデルはディープサーチにも大きく依存しています。1つのユーザークエリによって、多段階の推論や調査タスクを支えるためのウェブページ、PDF、画像、ビデオなどを取り込むために、バックグラウンドでの取得処理が数十件も発生する場合があります。ユーザーに表示されるのが短い回答であっても、その背後ではネットワーク上でメガバイト単位のデータがやり取りされることがあるのです。現在、プラットフォーム側はこうした高度な機能のコストを抑えるために利用制限を設けていますが、需要は急速に拡大しています。この規模が拡大すれば、推論に関連するデータ移動は大幅に増加します。

コンテキスト・ウィンドウの拡大で推論時のデータ移動が増加

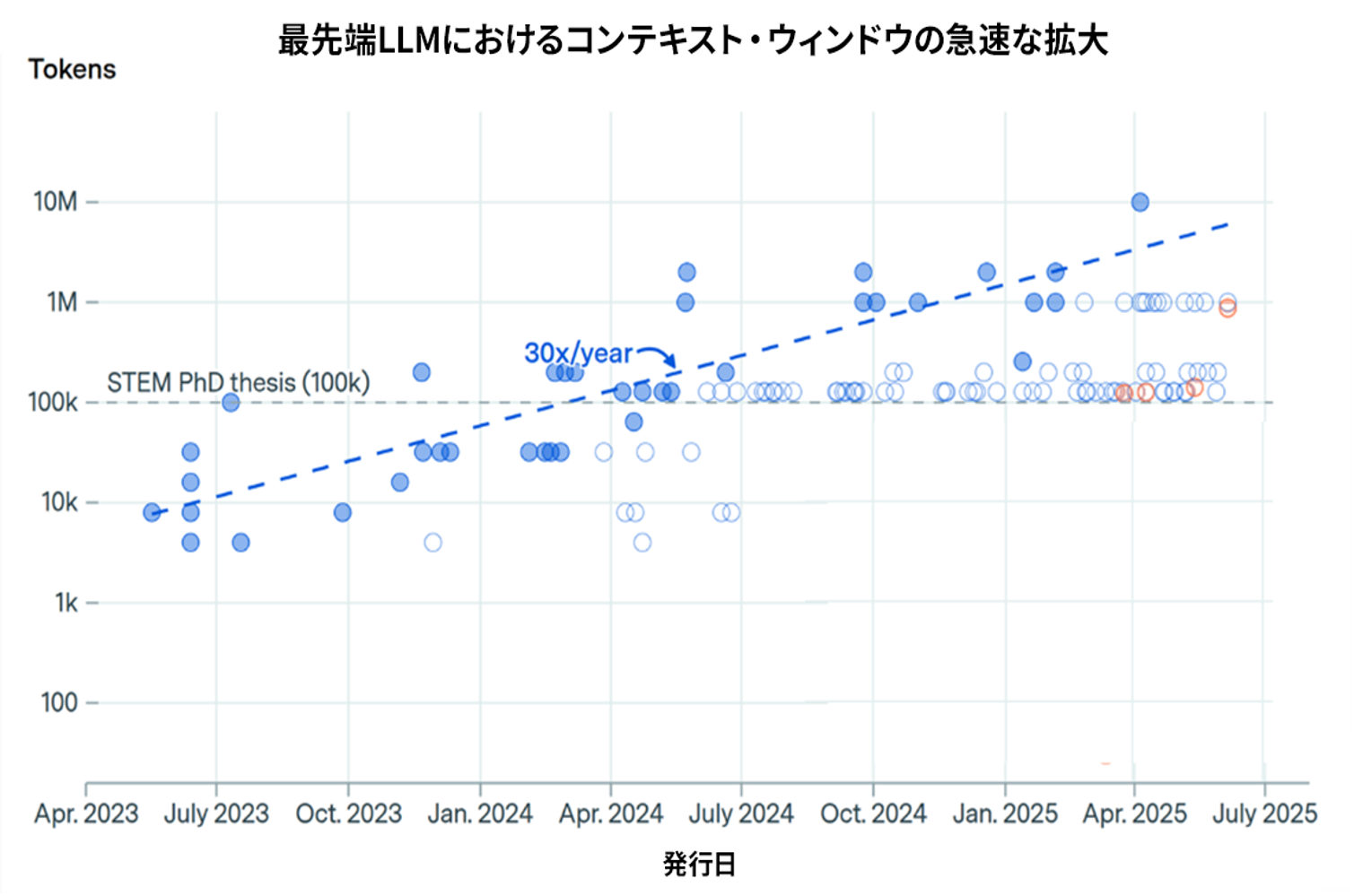

もう1つ、目立たないながらも重要なトレンドは、モデルのコンテキスト・ウィンドウが急速に拡大していることです。コンテキスト・ウィンドウとは、1回の推論セッションでモデルが処理できる情報量を指し、会話履歴、文書、指示、取得されたコンテンツなどが含まれます。過去2年間で、最先端モデルのコンテキスト・サイズは年率約30倍という驚異的なペースで拡大しています。

最先端LLMのコンテキスト・ウィンドウのサイズは、年率約30倍という著しいペースで拡大しています。

出典:Greg BurnhamおよびTom Adamczewski(2025)「LLMs now accept longer inputs, and the best models can use them more effectively」epoch.aiにてオンライン掲載、2026年1月5日取得。

コンテキスト・ウィンドウの拡大により、検索拡張生成(RAG)などの手法は大幅に有効性が高まります。特化型モデルをトレーニングする代わりに、アプリケーションではRAGによって大量の外部データを汎用モデルのプロンプトに直接組み込むことで、推論時の出力や判断を、より文脈に即した充実したものにできます。

ただし、この柔軟性には代償があります。プロンプトに補助データを付加することで上りトラフィックが増加し、さらにプロンプト投入前にクラウドベースのソースからRAGコンテンツを取得することで下りトラフィックも増加します。

AIネットワークにおける意味

推論のスケール拡大に伴い、AIの計算リソースは地理的に分散が進んでいます。モデルは地域間で同期する必要があり、利用データや学習シグナルも共有しなければなりません。複雑な推論ワークフローは、補完的な機能を持つ複数の拠点にまたがって実行されるケースが増えています。これらすべてがDCI帯域幅の大幅な増加につながるとともに、接続されるAI推論データセンターの数の増加にもつながっています。

現在、推論向けデータセンター間接続(DCI)の一般的なリンクは、1ルートあたりすでに数テラビット/秒で動作しています。今後5年間で、当社の分析に基づく保守的な想定でも、これらの要件は3~6倍に拡大し、ルートあたりの容量は数十テラビット/秒、さらには数百テラビット/秒に達する可能性があります。

AI推論向けデータセンター間接続における帯域要件の範囲(Tb/s)

出典:Ciena分析

AI推論のデータフローには相互に依存し変動しやすい要因が数多く影響しているため、そのネットワークへの影響を正確に予測することは困難です。しかし、方向性は明らかです。ネットワークの観点において、推論はもはや軽量なワークロードではなく、ネットワーク設計を左右する主要な要因になりつつあります。

まとめ

AI推論は、単純なテキストクエリから、リッチでマルチモーダルかつ推論主導のインタラクションへと、グローバル規模で進化しています。この変化によって、単に計算リソースの増加が求められるだけでなく、アクセス、メトロ、コア(海底および地上)、データセンター・ネットワーク全体にわたるトラフィックのパターンが根本的に様変わりします。

ネットワーク事業者にとって、AI推論による需要はもはや後回しにできるものではありません。AI対応ネットワークの設計を形作る重要な要素の1つとなりつつあり、データセンターの配置にも変化をもたらし、ホールセールおよびエンタープライズ分野における接続機会の拡大にもつながっています。

AI推論がトラフィック・パターンを変える中で、スケーラブルかつ高容量で回復力の高いアーキテクチャーに重点的に取り組むCienaは、AI主導のネットワーク変革の次の段階を通じて事業者を支えるポジションを確立します。